Dezentrale Tunnel-Protokolle & P2P-Onion-Routing Guide

TL;DR

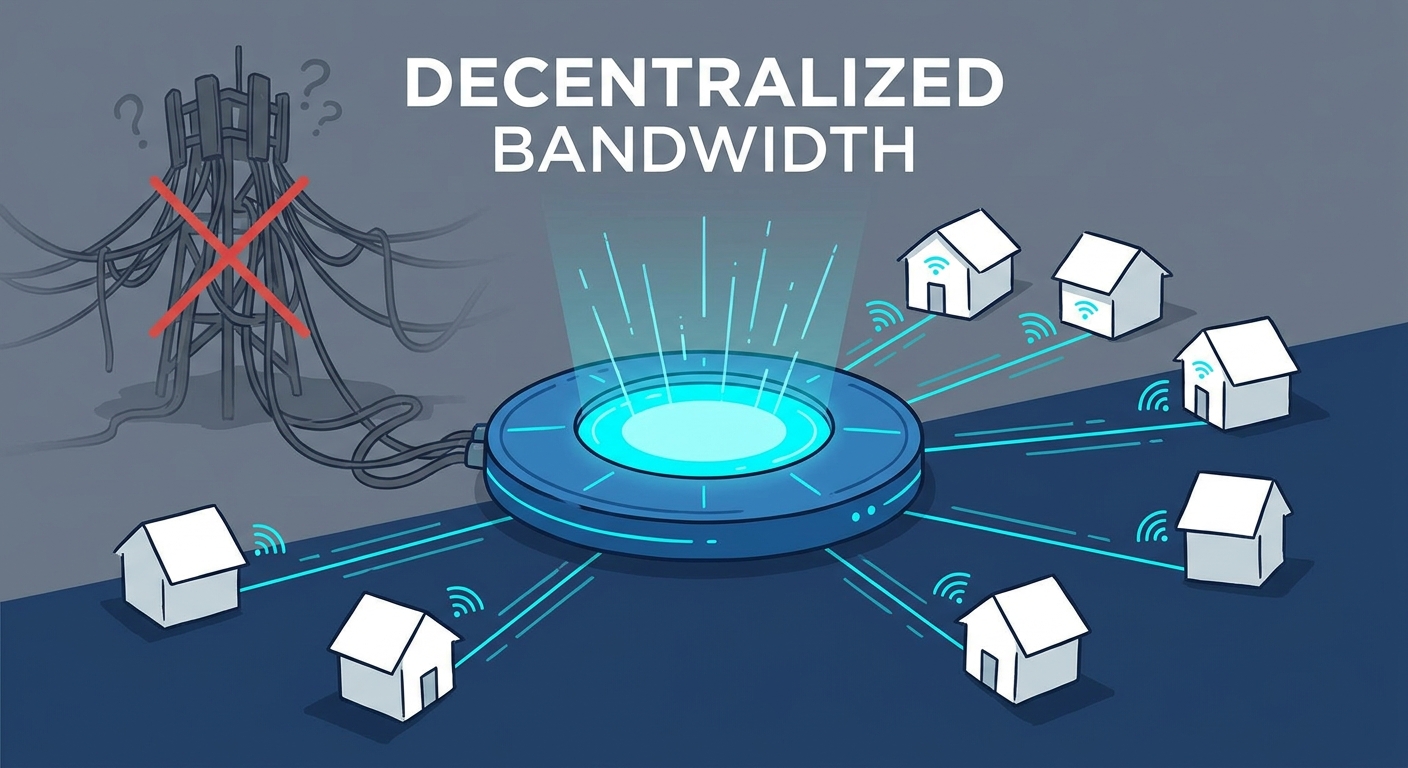

Der Wandel vom zentralisierten zum dezentralen Tunneling

Hatten Sie auch schon dieses ungute Gefühl bei dem Gedanken, dass Ihr „privater“ VPN-Anbieter im Grunde nur ein besserer Zwischenhändler ist, der auf einem Berg Ihrer Klartext-Logs sitzt? Es ist fast schon ironisch: Wir haben das Schnüffeln der Internetdienstanbieter (ISPs) gegen einen einzigen unternehmenseigenen Flaschenhals eingetauscht. Genau deshalb erreicht der Trend zum dezentralen Tunneling jetzt endlich den Mainstream.

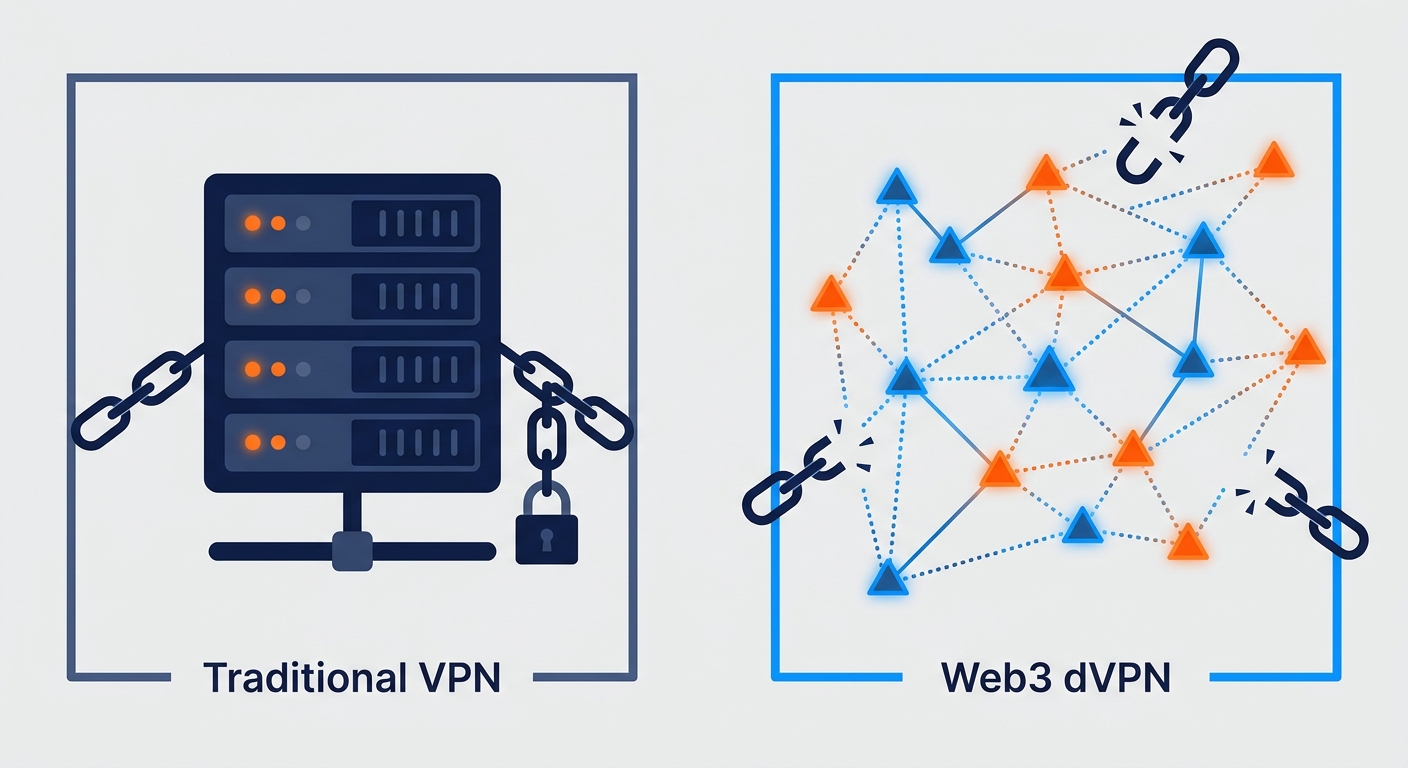

Die traditionelle VPN-Architektur ist ein Relikt der Client-Server-Mentalität der frühen 2000er Jahre. Sie verbinden sich mit einem „sicheren“ Gateway, doch dieses Gateway wirkt auf Hacker und staatliche Akteure wie ein riesiges Leuchtschild. Wenn dieser eine Server ausfällt oder beschlagnahmt wird, bricht Ihr gesamter Schutzwall augenblicklich in sich zusammen.

- Zentralisierte Honeypots: Wenn Millionen von Nutzern ihre Daten über eine Handvoll Rechenzentren eines einzigen Unternehmens leiten, entsteht ein „Single Point of Failure“. Dieser ist für Angreifer viel zu verlockend, um ihn zu ignorieren.

- Das Vertrauens-Paradoxon: Im Grunde verlassen Sie sich auf das Ehrenwort eines CEOs in einer Steueroase, dass keine Logs gespeichert werden. Ohne Open-Source-Audits des Backends fliegen Sie jedoch völlig im Blindflug.

- Skalierungs-Engpässe: Haben Sie bemerkt, wie Ihre Geschwindigkeit am Freitagabend in den Keller geht? Das liegt daran, dass zentrale Knoten die sprunghafte Last von modernem 4K-Streaming und rechenintensiven Entwickler-Workloads oft nicht bewältigen können.

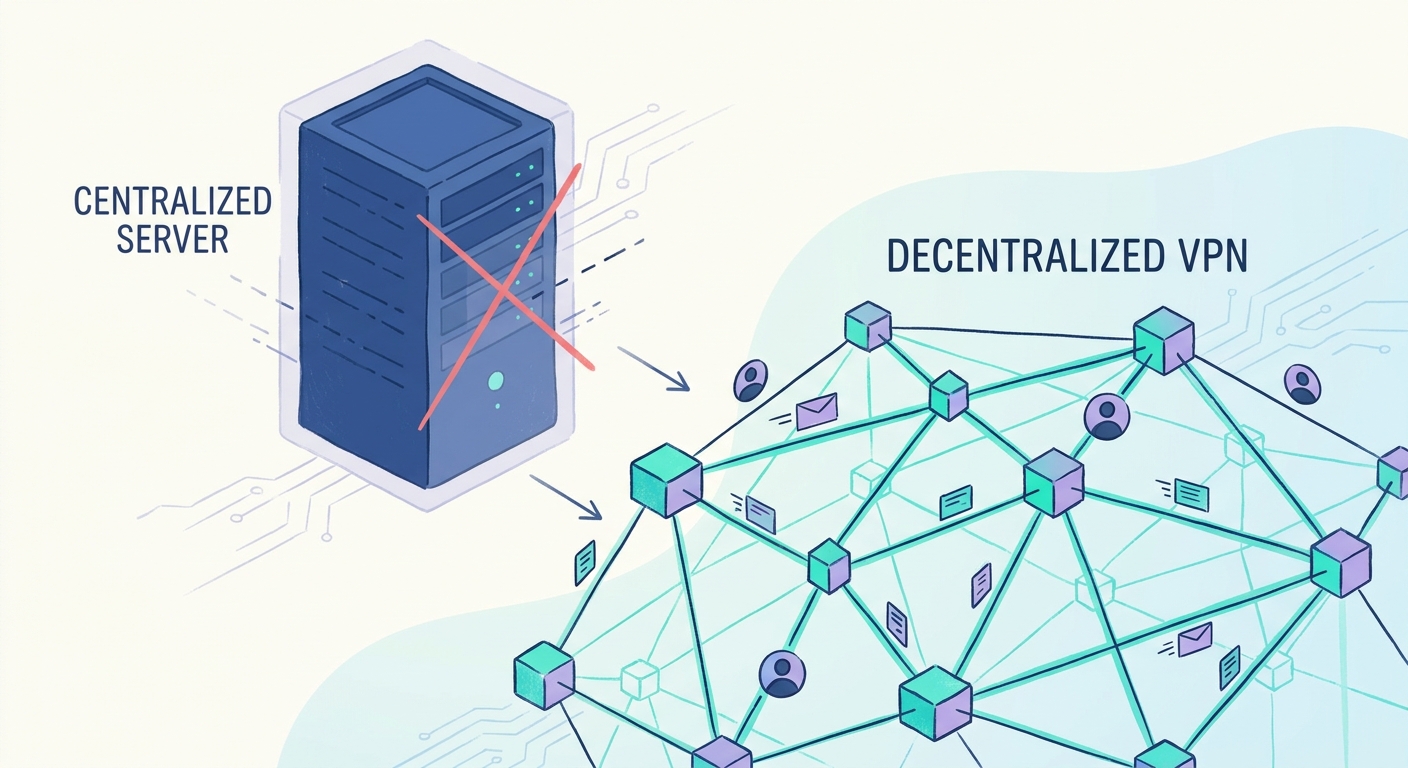

Wir bewegen uns hin zu einer „Map & Encap“-Logik (Mapping und Verkapselung), bei der das Netzwerk nicht auf ein zentrales Gehirn angewiesen ist. Anstatt eines einzelnen Anbieters nutzen wir dVPN-Knoten (Decentralized VPN), bei denen jeder Teilnehmer Bandbreite teilen kann. Diese Architektur – speziell Ansätze wie APT (A Practical Tunneling Architecture) – ermöglicht die Skalierung des Internets, indem sie „Edge“-Adressen vom „Transit-Kern“ trennt.

Im APT-Framework nutzen wir Ingress Tunnel Router (ITR) und Egress Tunnel Router (ETR). Stellen Sie sich den ITR als „Eingangstor“ vor, das Ihre normalen Daten aufnimmt und sie in einen speziellen Tunnel-Header einpackt (Verkapselung). Der ETR ist das „Ausgangstor“, das die Daten am Zielort wieder entpackt. Default Mapper (DMs) fungieren dabei wie ein Verzeichnisdienst: Sie teilen dem ITR genau mit, an welchen ETR das Paket gesendet werden muss. So müssen die Kern-Router nicht jedes einzelne Gerät auf dem Planeten auswendig kennen.

Stellen Sie sich eine Einzelhandelskette vor, die Point-of-Sale-Daten an 500 Standorten sichern möchte, ohne eine massive MPLS-Rechnung zu bezahlen. Anstatt eines zentralen Hubs nutzen sie einen knotenbasierten VPN-Dienst, bei dem jede Filiale als kleiner Hop in einem Mesh-Netzwerk fungiert. Wenn das Internet in einer Filiale ausfällt, leitet das P2P-Netzwerk den Tunnel automatisch über einen benachbarten Knoten um.

Für Entwickler bedeutet dies die Arbeit mit Tools wie WireGuard-Schnittstellen, die nicht an eine statische IP gebunden sind. Eine Konfiguration auf einem gehärteten Linux-Knoten könnte etwa so aussehen:

[Interface]

PrivateKey = <IHR_KNOTEN_SCHLÜSSEL>

Address = 10.0.0.5/32

ListenPort = 51820

[Peer]

PublicKey = <REMOTE_DVPN_KNOTEN_SCHLÜSSEL>

AllowedIPs = 0.0.0.0/0

Endpoint = 192.168.1.100:51820

PersistentKeepalive = 25

Dieses Setup ist wesentlich resilienter, da das „Mapping“ – also die Information, wohin ein Paket gesendet werden muss – über das gesamte Mesh verteilt ist und nicht in einer Datenbank in irgendeiner Firmenzentrale versteckt liegt. Ehrlich gesagt, ist es höchste Zeit, dass wir aufhören, um Erlaubnis für unsere Privatsphäre zu bitten.

Als Nächstes: Deep Dive in die P2P-Onion-Routing-Architektur – wir schauen uns an, wie diese Pakete den Sprung durch das Netzwerk tatsächlich überstehen.

Tiefenanalyse der P2P-Onion-Routing-Architektur

Haben Sie sich jemals gefragt, wie ein Datenpaket eigentlich drei verschiedene VPN-Tunnel und zwei Protokollkonvertierungen übersteht, ohne dabei den „Verstand“ oder seine Metadaten zu verlieren? Im Grunde ist das digitales Inception. Wenn wir die Architektur hier nicht präzise aufbauen, kollabiert das gesamte System in einem Chaos aus Paketverlusten und massiven Latenzen.

In einem P2P-Onion-Routing-Setup reichen wir den „heißen Pfad“ nicht einfach nur weiter. Jeder Knoten entscheidet selbst, wie er die Daten „einpackt“. Wenn wir hier von Onion-Schichten (Zwiebelschichten) sprechen, haben wir es primär mit zwei Mechanismen zu tun:

- Kapselung (Encapsulation): Ein komplettes IPv4-Paket wird genommen und in einen IPv6-Header gesteckt (oder umgekehrt). Der ursprüngliche Header wird für die äußere Schicht einfach zu „Nutzdaten“.

- Konvertierung: Hierbei wird der Header tatsächlich umgeschrieben, ähnlich wie bei NAT-PT. Das ist zwar ein „destruktiverer“ Prozess, aber bei Legacy-Hardware oft unumgänglich.

In einem Web3-VPN könnte Ihr Entry-Node Ihren Traffic via WireGuard kapseln, während ein Relay-Node eine weitere Verschlüsselungsebene hinzufügt, bevor das Paket den Exit-Node erreicht. Das macht die Blockierung weitaus schwieriger als bei traditionellem Tor, da das „Mapping“ nicht auf einer öffentlichen Liste von Relays steht, sondern dynamisch über das Mesh-Netzwerk ermittelt wird.

Klassisches Routing nutzt oft einen „Distanzvektor“ (wie viele Hops bis zum Ziel?). In einem P2P-Onion-Netzwerk reicht das jedoch nicht aus. Man muss den Zustand des Pakets kennen. Wenn ich ein IPv4-Paket habe, kann ich es nicht einfach an ein Relay senden, das ausschließlich IPv6 unterstützt.

Wie in der Studie von Lamali et al. (2019) dargelegt, nutzen wir stattdessen einen Stack-Vektor. Dieser ersetzt die einfache „Distanz“ durch einen „Protokoll-Stack“. Er signalisiert dem Knoten: „Um dieses Paket an sein Ziel zu bringen, benötigst du diese spezifische Sequenz an Kapselungen.“ Die Studie belegte, dass selbst wenn ein kürzester Pfad exponentiell lang ist, die maximal benötigte Höhe des Protokoll-Stacks tatsächlich polynomiell bleibt – konkret höchstens λn², wobei n die Anzahl der Knoten ist.

Für Entwickler ist das ein Durchbruch. Es bedeutet, dass wir keine Konfigurationsdatei mit 5.000 Zeilen benötigen, um verschachtelte Tunnel zu verwalten. Die Knoten „lernen“ den Stack. Ein Beispiel: Ein Gesundheitsdienstleister, der die veraltete IPv4-Infrastruktur einer abgelegenen Klinik mit einem modernen IPv6-Rechenzentrum verbinden möchte, kann die P2P-Knoten die Tunnel-Endpunkte automatisch aushandeln lassen.

Wenn Sie einen Knoten härten, analysieren Sie wahrscheinlich, wie diese Stacks in Ihren Schnittstellen abgebildet werden. Hier ist eine grobe Vorstellung davon, wie ein Knoten einen „Cache-Hit“ für einen spezifischen Stack verarbeiten könnte:

# Die Ausgabe dieses Befehls zeigt die exakte Kapselungssequenz

# (z. B. IPv4 in WireGuard in IPv6), um den Pfad zu debuggen.

dvpn-cli route-lookup --dest 10.0.0.5 --current-stack "ipv4.wireguard.ipv6"

ip link add dev dvpn0 type wireguard

wg setconf dvpn0 /etc/wireguard/stack_config.conf

Das Schöne daran ist, dass das Mesh-Netzwerk Ausfälle selbstständig kompensiert. Wenn ein Relay-Node offline geht, findet die Stack-Vektor-Logik den „kürzesten machbaren Pfad“ unter Verwendung einer anderen Kombination von Kapselungen. Es ist ein selbtheilendes System. Ganz ehrlich: Wenn man das einmal in Aktion gesehen hat, fühlt sich die Rückkehr zu statischen VPN-Tunneln an wie das Telefonieren mit einer Wählscheibe in einer 5G-Welt.

Als Nächstes: Sicherheitsherausforderungen beim dezentralen Internetzugang – denn zufälligen Knoten zu vertrauen, ist eine ganz eigene Herausforderung.

Sicherheitsherausforderungen beim dezentralen Internetzugang

Wer glaubt, dass der Wechsel zu einem P2P-Netzwerk alle Sicherheitsprobleme wie von Zauberhand löst, den muss ich leider enttäuschen – im Grunde tauscht man lediglich die zentrale „God-Box“ eines Konzerns gegen den digitalen Wilden Westen ein. Der Übergang von einem zentralisierten VPN zu einem dezentralen Dienst (dVPN) ist zwar ein riesiger Gewinn für die Privatsphäre, bringt aber völlig neue technische Hürden mit sich.

Wie vertraut man dem ersten Knotenpunkt (Node), wenn man dem Netzwerk beitritt? Da es keine zentrale Liste gibt, setzen die meisten dVPNs auf Seed-Nodes oder DHT-Bootstrapping (Distributed Hash Table). Ihr Client verbindet sich dabei mit einigen fest im Code hinterlegten, bekannten „Seed“-Adressen, nur um eine Liste anderer aktiver Peers zu erhalten. Von dort aus erkundet der Client das Mesh-Netzwerk eigenständig.

Sobald Sie Teil des Netzwerks sind, nutzen wir ein Web-of-Trust-Modell, bei dem die Nodes ihre Nachbarn gegenseitig verifizieren:

- Neighbor-to-Neighbor-Verifizierung: Bevor ein Node Routing-Informationen verbreiten darf, bestätigen seine Peers dessen Identität über etablierte Verbindungen.

- Signature Flooding: Sobald ein Schlüssel von genügend vertrauenswürdigen Nachbarn signiert wurde, wird diese Information per „Flooding“ im gesamten Mesh verteilt.

- Erkennung korrupter Nodes (Rogue Nodes): Wenn ein Node behauptet, Traffic für einen IP-Bereich zu routen, den er gar nicht besitzt, erkennt der tatsächliche Besitzer diese widersprüchliche Nachricht und löst einen Alarm aus.

Der größte Fallstrick beim P2P-Bandbreitenaustausch ist der sogenannte Churn (die Fluktuation). Im Gegensatz zu einem Rechenzentrum mit 99,99 % Uptime kann ein privater dVPN-Node jederzeit verschwinden – etwa weil die Katze über das Stromkabel gestolpert ist. Um dieses Problem zu lösen, nutzen wir ein datengesteuertes Ausfall-Benachrichtigungssystem. Anstatt dass das gesamte Netzwerk versucht, permanent eine „perfekte“ Karte aller Nodes vorzuhalten, wird der Ausfall lokal genau dann behandelt, wenn ein Datenpaket tatsächlich nicht zugestellt werden kann.

Der Default Mapper (DM) übernimmt hier die Schwerarbeit: Er wählt einen neuen Pfad aus und weist den ITR an, seinen lokalen Cache zu aktualisieren. Dabei greifen wir auf die bereits erwähnte λn²-Effizienz zurück, um das Rerouting extrem schnell zu halten.

Als Nächstes: Am Ball bleiben bei der Privacy-Revolution – hier werfen wir einen Blick auf die technische Wartung und Instandhaltung dieser dezentralen Knotenpunkte.

Am Puls der Privatsphäre-Revolution bleiben

Es ist beeindruckend, wie rasant sich die Landschaft rund um den digitalen Datenschutz derzeit verändert. Um auf dem Laufenden zu bleiben, reicht es längst nicht mehr aus, nur gelegentlich einen Blog zu lesen; man muss verstehen, wie diese neuen Protokolle die eigenen Datenpakete tatsächlich verarbeiten.

Im dVPN-Sektor wird viel über „Moon“-Preise spekuliert, aber der wahre Wert liegt in den technischen Spezifikationen. Ein entscheidender Punkt ist beispielsweise, wie ein Netzwerk den IPv6-Leak-Schutz handhabt. Bei herkömmlichen VPNs umgeht der IPv6-Traffic oft den gesamten Tunnel, wodurch die echte IP-Adresse preisgegeben wird. Im dVPN-Kontext setzen wir häufig auf NAT64 oder 464XLAT. Dies erzwingt die Übersetzung von IPv6-Traffic in IPv4 (oder umgekehrt) auf Node-Ebene. So wird sichergestellt, dass die Daten innerhalb des verschlüsselten „Stack-Vector“-Pfades bleiben, anstatt über ein lokales Gateway abzufließen.

- Folgen Sie den Commits: Vertrauen Sie nicht blind einer Website, sondern prüfen Sie das GitHub-Repository. Wenn ein Projekt seine WireGuard-Implementierung oder die Node-Discovery-Logik seit sechs Monaten nicht aktualisiert hat, handelt es sich höchstwahrscheinlich um ein „Zombie-Projekt“.

- Audit-Berichte: Seriöse Privacy-Tools investieren in Sicherheitsaudits durch unabhängige Dritte.

- Community-Foren: In spezialisierten Entwickler-Discords findet der eigentliche Wissensaustausch statt.

Wer es ernst meint, experimentiert wahrscheinlich bereits mit eigenen Konfigurationen. Hier ist ein schneller Weg, um zu prüfen, ob Ihr aktueller Tunnel den dezentralen Pfad tatsächlich einhält:

ip route show dev dvpn0

traceroute -n -i dvpn0 1.1.1.1

Ich habe schon etliche Setups gesehen, bei denen Nutzer dachten, sie seien „unsichtbar“, während ein einfacher, falsch konfigurierter API-Aufruf ihre echte IP-Adresse leakte. Es ist ein ständiges Katz-und-Maus-Spiel.

Als Nächstes schauen wir uns den Bandbreiten-Marktplatz und die DePIN-Rewards an – denn am Ende muss schließlich jemand für den Strom bezahlen.

Der Bandbreiten-Marktplatz und DePIN-Belohnungen

Wir haben nun geklärt, wie die Datenpakete fließen. Aber seien wir ehrlich: Niemand wird dauerhaft einen Hochgeschwindigkeits-Exit-Node aus reiner Nächstenliebe betreiben. Hier kommt das Konzept des „Airbnb für Bandbreite“ ins Spiel, in Fachkreisen auch als DePIN (Decentralized Physical Infrastructure Networks) bekannt.

- Bandbreiten-Mining: Sie verdienen Krypto-Rewards allein dadurch, dass Sie einen Node online halten und Traffic weiterleiten.

- Tokenisierte Ressourcen: Die Nutzung eines nativen Netzwerk-Tokens ermöglicht Mikro-Zahlungen für jedes übertragene Megabyte.

- Anreiz-Optimierung: Die Belohnungen werden basierend auf der Uptime (Betriebszeit) und der Dienstqualität („Quality of Service“) gewichtet.

Die größte technische Hürde dabei ist: Wie stellt man sicher, dass ein Node nicht über das tatsächlich verarbeitete Datenaufkommen lügt? Hierfür nutzen wir Proof-of-Bandwidth-Protokolle. Dabei sendet ein „Challenger“-Node verschlüsselte Testdaten an einen „Prover“-Node und misst die Antwortzeit sowie das Volumen. Wenn die Zahlen nicht übereinstimmen, gibt der Smart Contract die Zahlung nicht frei.

Ohne eine präzise Programmierung der Belohnungslogik könnten Nodes dazu neigen, ausschließlich hochbezahlten Traffic zu bevorzugen. Um dies zu verhindern, setzen viele Netzwerke auf das sogenannte „Staking“. Dabei müssen Betreiber Token als Sicherheit hinterlegen. Wer eine mangelhafte Servicequalität liefert, riskiert den Verlust seines Einsatzes (Slashing).

Als Nächstes: Praktische Umsetzung und die Zukunft der Web3-Internetfreiheit – wie alle Puzzleteile ineinandergreifen.

Praktische Umsetzung und die Zukunft der Web3-Internetfreiheit

Die Zukunft der Web3-Internetfreiheit wird nicht durch einen plötzlichen „Big Bang“ eingeleitet. Es wird vielmehr ein schrittweiser, teils komplexer Prozess sein, bei dem dezentrale Protokolle direkt neben unseren bestehenden Glasfaserleitungen koexistieren.

Wir müssen das Rad nicht neu erfinden. Die Stärke des architektonischen Wandels liegt darin, dass er für ein „einseitiges Deployment“ ausgelegt ist. Ein einzelner Anbieter kann bereits heute damit beginnen, diese Dienste anzubieten. Wir nutzen dabei Default Mapper (DMs), um diese „Inseln“ von P2P-Netzwerken miteinander zu verbinden.

- Koexistenz mit Legacy-Hardware: Ihr Heimrouter muss nicht einmal wissen, dass er mit einem P2P-Netzwerk kommuniziert. Ein lokales Gateway übernimmt die gesamte „Map & Encap“-Logik (Mapping und Kapselung).

- Überbrückung von Lücken: Wenn ein Datenpaket an eine „normale“ Website gesendet werden muss, übernimmt der Egress-Node (ETR) die Entkapselung (Decapsulation).

- Nutzerfreundliche Abstraktion: Für technisch nicht versierte Anwender fühlt sich das Ganze wie eine einfache App an, obwohl im Hintergrund komplexes Stack-Vector-Routing verwaltet wird.

Aus Entwicklersicht ist das Ziel, diese Tunnel „automatisch“ zu generieren. Hier ist ein kurzer Einblick, wie ein Node ein „Island-Mapping“ abfragen könnte:

dvpn-cli map-query --dest 192.168.50.1

[DEBUG] Cache miss. Querying DM anycast...

[INFO] Received MapRec: Destination reachable via ETR 203.0.113.5

Das ultimative Ziel ist ein Netzwerk, das praktisch unmöglich abgeschaltet werden kann. Durch die Kombination einer Blockchain-VPN mit P2P-Onion-Routing entsteht ein System ohne zentralen „Ausschalter“. Wie bereits erwähnt, erlaubt uns die λn²-Komplexität eine tiefgreifende, mehrschichtige Privatsphäre, ohne dass das Netzwerk unter der Last zusammenbricht.

Bei der Zukunft des Bandbreiten-Sharings geht es nicht nur darum, ein paar Euro zu sparen; es geht um globale Konnektivität, die digitale Mauern umgeht. Momentan ist der Prozess noch etwas holprig und die Terminal-Befehle können mühsam sein, aber das Fundament steht. Das Internet war von Anfang an als dezentrales System gedacht – wir bauen jetzt endlich die Architektur, um diesen Zustand dauerhaft zu sichern. Aber genug der Theorie: Es ist an der Zeit, die ersten Nodes hochzufahren. Bleiben Sie sicher da draußen.